Sommaire

À mesure que les systèmes d'IA gagnent en complexité, il est de plus en plus nécessaire de les connecter à un large éventail d'outils, d'API et de sources de données. Le Protocole de contexte modèle (MCP), développé par Anthropic, est un standard ouvert conçu pour simplifier cette intégration en fournissant une interface cohérente. Considérez MCP comme USB-C pour les applications d'IA—une prise standardisée qui connecte les grands modèles de langage (LLM) à tout ce dont ils ont besoin.

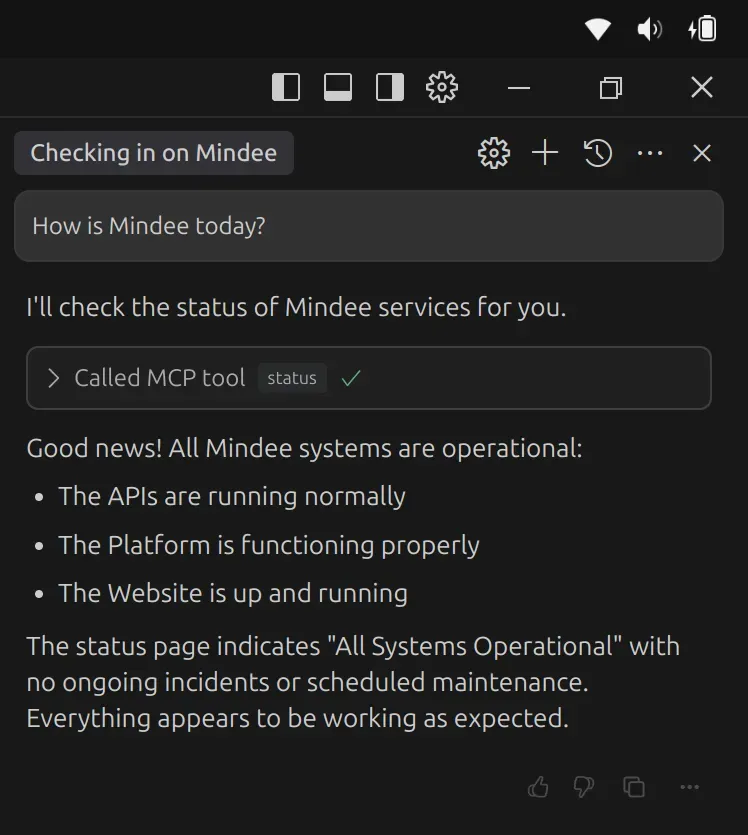

Exemple concret : Claude utilise MCP pour vérifier le statut de Mindee

Avant de nous plonger dans le fonctionnement du Model Context Protocol (MCP), examinons un exemple concret et pratique.

Imaginez que vous utilisez un assistant IA alimenté par Claude, et vous demandez : « Comment va Mindee aujourd'hui ? »

Au lieu de s'appuyer sur des données obsolètes ou des recherches génériques sur le Web, Claude utilise le MCP pour appeler un outil qui récupère l'état actuel du système directement depuis l'infrastructure de Mindee.

Voici à quoi pourrait ressembler cette interaction :

Dans les coulisses, Claude a invoqué un outil exposé via MCP. Cet outil a récupéré l'état du système en temps réel à partir de la page d'état de Mindee et a renvoyé une réponse structurée et conviviale :

- Les API fonctionnent normalement

- La plateforme fonctionne correctement

- Le site Web est opérationnel

C'est l'essence même de MCP : permettre à des modèles tels que Claude d'effectuer des actions contextuelles en direct par le biais d'appels d'outils sécurisés et structurés, comme un développeur peut interroger une API, mais sans écrire de ligne de code.

Qu'est-ce que le MCP ?

Le Model Context Protocol (MCP) permet aux modèles d'IA de communiquer avec des systèmes externes, tels que des API, des bases de données ou des services cloud, via un protocole standardisé. Les développeurs n'ont donc plus besoin de créer des adaptateurs personnalisés pour chaque intégration, ce qui réduit la complexité et permet des applications d'IA plus modulaires.

Avec MCP, les développeurs peuvent connecter des LLM à :

- Outils internes (tels que des CRM ou des bases de données)

- API externes (comme Jira ou Slack)

- Sources de données statiques ou actives (telles que des fichiers CSV ou des e-mails)

🔗 Site officiel: modelcontextprotocol.io

📚 Documents et outils communautaires: firemcp.com

Et si vous êtes un apprenant visuel, cette vidéo de ByteByteGo fournit un excellent aperçu de ce que MCP permet :

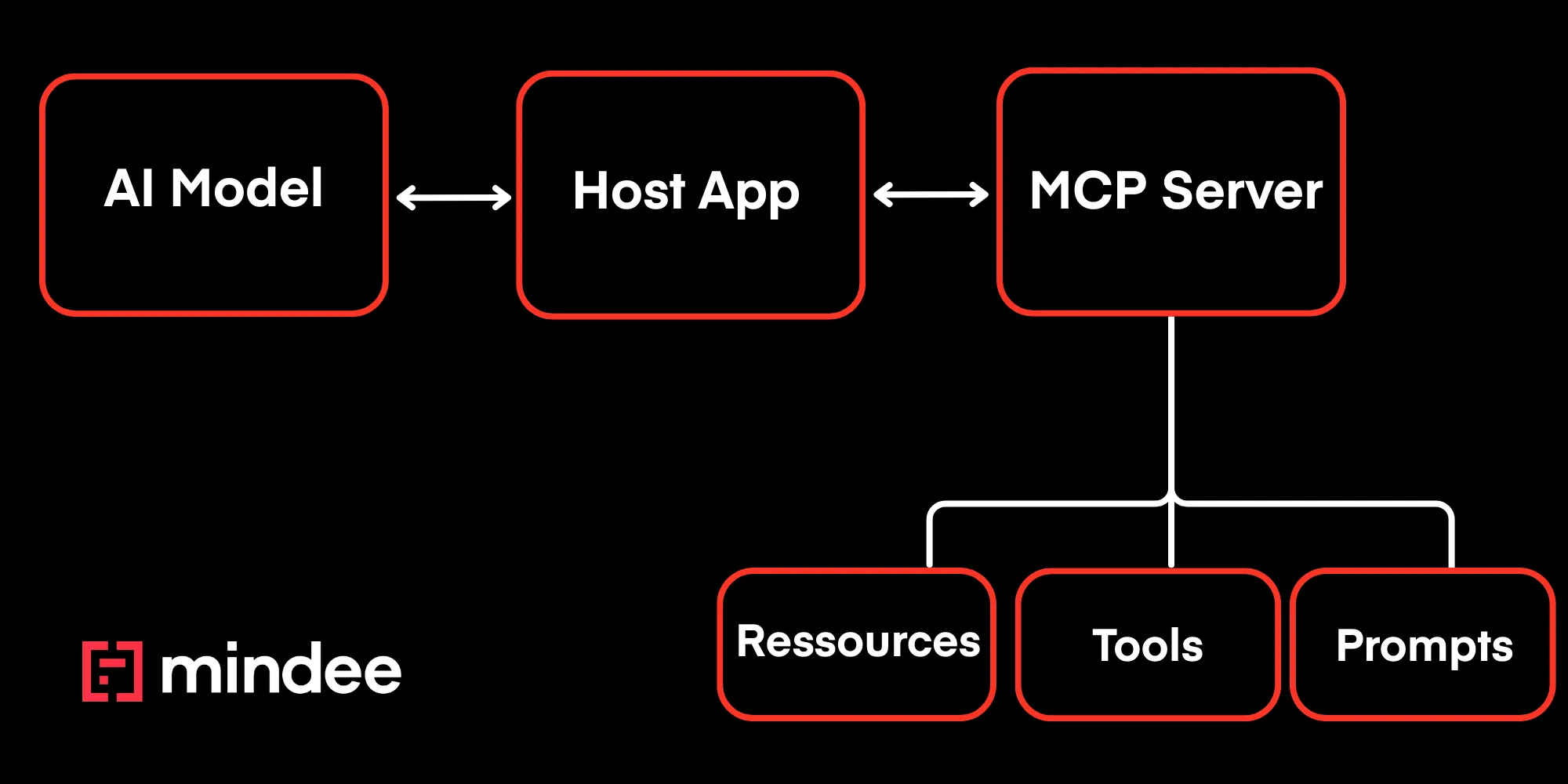

Composants de base du MCP

MCP suit un architecture client-serveur composé de trois éléments clés :

🧱 Ressources

Ensembles de données statiques ou dynamiques auxquels les modèles d'IA peuvent accéder. Exemples :

- Un dossier de documents

- Contenu de la boîte de réception

- Une base de données des commandes des clients

🛠️ Outils

Fonctions ou services invocables que le modèle peut utiliser. Il peut s'agir notamment des éléments suivants :

- Un appel d'API pour récupérer les données météorologiques

- Une fonction pour planifier des réunions

- Un outil pour mettre à jour un tableau Trello

💬 Insignes

Des modèles d'invite prédéfinis qui indiquent comment l'IA interagit avec les ressources et les outils. Ces instructions normalisent les instructions et aident à structurer les sorties de l'IA.

Cette architecture permet de étendre les fonctionnalités LLM de manière modulaire et réutilisable.

Par exemple, l'intégration à des API spécialisées comme celle de Mindee API AI Resume pour une extraction avancée de données permet aux assistants IA de traiter et d'extraire efficacement les données structurées des CV, améliorant ainsi les flux de travail de recrutement.

Comment fonctionne MCP

Chaque système MCP implique :

- UNE application hôte qui gère les interactions avec l'IA

- Un ou plusieurs clients connexion à Serveurs MCP, qui présentent des outils, des ressources et des instructions

📡 Protocoles de communication :

- Local: via studio (entrée/sortie standard)

- télécommande: via HTTP en utilisant Événements envoyés par le serveur (SSE) pour les mises à jour en direct

Cette conception flexible prend en charge à la fois le développement local et les déploiements dans le cloud, ce qui le rend adapté à un large éventail de cas d'utilisation.

🧩 Exemple : connexion d'un modèle d'IA à un gestionnaire de tâches

Voici comment un LLM pourrait utiliser MCP pour interagir avec un outil de gestion de projet :

{

"tool": "createTask",

"params": {

"title": "Follow up with client",

"due_date": "2025-04-24"

}

}

Le client MCP les transmet au serveur, qui exécute l'outil et renvoie le résultat, ce qui permet au modèle de créer des tâches à la volée.

Considérations de sécurité

MCP est conçu avec la sécurité à l'esprit. Il utilise un modèle de sécurité médiatisé par l'hôte où :

- L'hôte définit ce à quoi l'IA peut accéder

- Toutes les communications passent par l'hôte

- Les développeurs peuvent appliquer des autorisations précises et des pistes d'audit

Cette configuration empêche les actions non autorisées et limite la portée des interactions entre les modèles, une fonctionnalité essentielle pour les environnements d'entreprise.

Cas d'utilisation : là où MCP brille

MCP fait déjà sensation dans de nombreux secteurs d'activité :

Les entreprises qui adoptent le MCP incluent OpenAI, Google DeepMind, Microsoft, Firebase, Codeium et Sourcegraph.

En tirant parti du MCP, les systèmes d'IA peuvent accéder aux indicateurs de performance stockés dans des bases de données chronologiques et les analyser. L'approche de Mindee en matière Agréger les données de séries chronologiques avec TimescaleDB illustre la façon dont les agrégats continus peuvent fournir des informations en temps réel sur l'utilisation des API.

Intégrer des fonctionnalités d'OCR avancées, telles que celles décrites dans Mindee's Améliorer l'OCR des factures grâce à l'intégration de LiLT, permet aux modèles d'IA d'extraire avec précision les données de divers formats de factures, rationalisant ainsi les opérations financières

Débuter avec MCP

MCP est open source et propose des SDK en plusieurs langues :

- Python

- Tapez Script

- Java/ Kotlin

- C#

🔧 Exemples de référentiels et de kits de développement logiciel:

- SDK Python sur GitHub

- Explorez Pompier CP pour des exemples communautaires, des mises à jour et des outils de développement

Défis et considérations

Bien que le MCP présente des avantages importants, les développeurs doivent être conscients de certaines choses :

- Conception d'outils: vous devrez définir avec soin les outils et les instructions pour éviter toute action involontaire.

- Latence: les appels d'outils à distance via SSE peuvent introduire une certaine latence, en particulier dans flux de travail en plusieurs étapes.

- Contrôle d'accès: La gestion des autorisations et de la confidentialité des données sur de multiples outils nécessite une planification réfléchie.

Malgré ces considérations, la conception structurée de MCP permet d'atténuer de nombreux pièges courants liés à l'intégration de l'IA.

Vue d'ensemble visuelle

Voici une vue simplifiée de la façon dont MCP relie tout :

Réflexions finales

Le Model Context Protocol est sur le point de devenir couche fondamentale dans le futur du développement de l'IA. En adoptant le MCP, les équipes peuvent réduire les frais d'intégration, renforcent la sécurité et font évoluer leurs applications d'IA de manière plus efficace.

Que vous créiez un assistant développeur, un robot de service client ou un tableau de bord intelligent, MCP fournit les éléments de base nécessaires pour connecter votre modèle au monde réel.

À propos

.svg)

.svg)

.webp)

.webp)

.webp)